X ka njoftuar hapjen e një zyre në Austin (Texas) për ekipin e ri të Trust and Safety, i cili kryesisht do të merret me identifikimin e përmbajtjes së CSE (Shfrytëzimi Seksual i Fëmijëve), por moderimi do të ketë të bëjë edhe me rreziqe të tjera, siç mund të lexohet në shpalljen e punës. Sipas Bloomberg, kompania kaliforniane do të punësojë 100 persona me kohë të plotë.

Zero tolerancë për shfrytëzimin e fëmijëve

Kompania kaliforniane ka pasur gjithmonë një ekip Trust and Safety, por ai praktikisht u çmontua (pak njerëz mbetën) nga Elon Musk për të ulur kostot pas blerjes. Moderimi i përmbajtjes kryesisht shfrytëzon sistemet e automatizuara dhe raportet e përdoruesve nëpërmjet “shënimeve kolektive” me rezultate joefektive (siç tregohet nga rasti i fundit i imazheve të rreme të Taylor Swift).

CEO Linda Yaccarino do të dëgjohet nga Komiteti Gjyqësor i Senatit të SHBA më 31 janar në lidhje me moderimin e përmbajtjes së CSE. X shfrytëzoi rastin për të nënvizuar progresin e arritur në luftimin e kësaj veprimtarie të paligjshme. Në vitin 2023, 12.4 milionë llogari u pezulluan dhe 8,500 raporte u dërguan në Qendrën Kombëtare për Fëmijët e Zhdukur dhe të Shfrytëzuar (NCMEC).

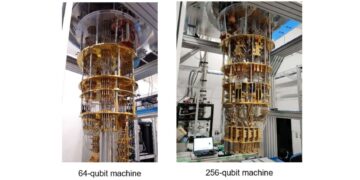

Identifikimi i imazheve, videove dhe GIF-ve ndodh përmes ndërhyrjes manuale dhe me sistemin “media hash matching” i zhvilluar nga Thorn. Kompania kaliforniane premtoi të përmirësonte zbulimin e përmbajtjes së CSE dhe njoftoi hapjen e një zyre në Austin. Ai do të përbëhet nga 100 persona që do të verifikojnë respektimin e rregullave të tjera, si ato për gjuhën e urrejtjes dhe postimet e dhunshme. Në shpalljen e punës ka edhe referenca për spam dhe mashtrime.

Moderimi i përmbajtjes është një nga fushat ku Komisioni Evropian ka nisur procedurat formale kundër X për të zbuluar shkelje të mundshme të Aktit të Shërbimeve Dixhitale.

Discussion about this post